殺人機(jī)器人:危險(xiǎn)不科幻

圖為科幻電影《終結(jié)者》中的金屬機(jī)器人。CFP

【縱深報(bào)道】

2029年,人類和智能機(jī)器人之間的一場大戰(zhàn)打響:機(jī)器人“終結(jié)者”奉命殺死約翰·康納的母親莎拉·康納——這是由詹姆斯·卡梅隆于1984年創(chuàng)作的5部系列電影的序曲。科幻作家沒有料想到,如今的科技已經(jīng)可以制造出這樣的機(jī)器人:它們一旦被授予使命后,會(huì)自發(fā)地做出殺人甚至暴動(dòng)的決定。

這些機(jī)器人殺手在國際軍備討論中有一個(gè)恰如其分的名字:LAWS(Lethal Autonomous Weapons Systems,致命性自主武器系統(tǒng))。這種機(jī)器人已經(jīng)登上了歷史的舞臺(tái),將它們帶到戰(zhàn)場上會(huì)引起各種各樣的爭議:如何定義這些機(jī)器人?它們到底能做什么?戰(zhàn)場上的倫理問題如何解決?

1942年,著名的美籍俄羅斯裔科幻作家艾薩克·阿西莫夫在《驚奇科幻小說》中提出了機(jī)器人的倫理問題,他被世人視為機(jī)械倫理學(xué)之父。阿西莫夫在1942年出版的小說《轉(zhuǎn)圈圈》中描述了機(jī)器人三定律。他提出,所有的機(jī)器人程序都必須考慮到這三條定律,目的是為了約束這些自主機(jī)器人的行為,讓它們服從以保護(hù)人類為目的的強(qiáng)制性道德準(zhǔn)則。

■阿西莫夫機(jī)器人定律

第一定律:機(jī)器人不得傷害人類,或坐視人類受到傷害;

第二定律:除非違背第一法則,否則機(jī)器人必須服從人類的命令;

第三定律:在不違背第一及第二法則下,機(jī)器人必須保護(hù)自己。

此后,阿西莫夫又添加了一條定律,即第零定律:機(jī)器人不得傷害人類族群,或因不作為使人類族群受到傷害。

機(jī)器人遵守這些定律而引發(fā)的困局是阿西莫夫所著500本書籍的主題。他嚴(yán)肅地思考了這些定律的意義,并想象了這些定律被采納時(shí)發(fā)生的情形。然而時(shí)至今日,阿西莫夫關(guān)于機(jī)械倫理的設(shè)想并未如愿:如今的機(jī)器人并沒有安裝強(qiáng)制它們服從機(jī)器人定律的機(jī)制或指令。為什么會(huì)這樣呢?

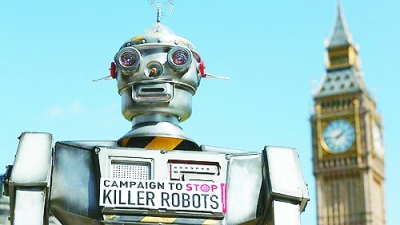

圖為民眾抗議殺人機(jī)器人的研發(fā)。資料圖片

■無法服從機(jī)器人定律

現(xiàn)在的機(jī)器人擁有的功能和人們當(dāng)初設(shè)想的不太一樣。科技并沒有讓我們憑空創(chuàng)造出和自己一樣的東西,我們并不能像對(duì)待奴隸或傭人那樣指使它們。機(jī)器人以及智能系統(tǒng)的產(chǎn)生并非一蹴而就,因?yàn)榭萍伎偸茄刂庀氩坏降姆较蚯斑M(jìn)。這樣一來,如何準(zhǔn)確區(qū)分機(jī)器人和智能系統(tǒng)就變得十分棘手。

駕駛飛機(jī)平安降落的自主系統(tǒng)能否稱為機(jī)器人?它是否具有智能?我們很容易得出否定的答案。這個(gè)自主系統(tǒng)操作飛機(jī)的能力和人類飛行員一樣好,而且對(duì)自己的方位了如指掌,所以才能讓飛機(jī)準(zhǔn)確降落。雖然它的功能很有限,但在降落飛機(jī)這項(xiàng)人命關(guān)天的任務(wù)上,它和人類相比毫不遜色。

現(xiàn)代社會(huì)中機(jī)器人的工作非常專業(yè)化,它們不具備與人類用通俗語言交流的能力。我們無法要求它們遵守阿西莫夫的機(jī)器人定律,因?yàn)樗鼈兺耆荒芾斫膺@些定律的意義。如果想要應(yīng)用機(jī)器人定律,智能系統(tǒng)必須具備邏輯分析和推理能力,并且能夠預(yù)測行為所導(dǎo)致的后果,以判斷人類下達(dá)的指令是否和任何一條定律相悖。但目前,機(jī)器人還不能進(jìn)行這樣的分析。

美國iRobot公司的創(chuàng)始人羅德尼·布魯克斯曾就上述問題直白地表達(dá)了自己的觀點(diǎn)。媒體問他,為何iRobot生產(chǎn)的機(jī)器人不能自動(dòng)遵守阿西莫夫定律,他回答,“理由很簡單,我們根本沒法把阿西莫夫的定律寫入它們的系統(tǒng)中。”雖然未來的智能系統(tǒng)可能會(huì)隨著科技的進(jìn)步而發(fā)展出智力,并且智能系統(tǒng)中負(fù)責(zé)自主抉擇的組件會(huì)獲得性能提升,但這種機(jī)器智力和人類智力仍然不可同日而語。也就是說,科幻作家當(dāng)初讓機(jī)器人理解和服從阿西莫夫定律的希望,現(xiàn)在已經(jīng)變成了一件異想天開的事。但是,這并非意味著討論機(jī)械倫理問題就是多此一舉。因?yàn)樵谧詣?dòng)駕駛領(lǐng)域,相關(guān)研發(fā)已經(jīng)進(jìn)行了許多年,多家公司設(shè)計(jì)的性能穩(wěn)定的產(chǎn)品也將進(jìn)入市場,因此討論機(jī)械倫理問題的時(shí)機(jī)已經(jīng)成熟。

圖為美國的無人機(jī)。資料圖片

■機(jī)器人的道德問題

設(shè)想這樣一個(gè)場景:一輛高速行駛的無人駕駛汽車前方,出現(xiàn)了一個(gè)追逐皮球而橫穿馬路的孩子,而逆向車道上有一個(gè)騎著自行車的成年人。此時(shí),自動(dòng)駕駛系統(tǒng)經(jīng)過分析會(huì)有兩種選擇:一是減速但維持前進(jìn)方向不變,這樣有可能撞到孩子;二是減速并向左轉(zhuǎn)向,這將會(huì)威脅到騎行者的安全。自動(dòng)駕駛系統(tǒng)應(yīng)該如何抉擇?撞向孩子還是成年人?

經(jīng)常有媒體表示,自動(dòng)駕駛汽車可媲美人類司機(jī),這也是一些汽車制造商在標(biāo)榜安全性時(shí)提到的新賣點(diǎn)。這種觀點(diǎn)的受眾范圍很廣,讓我們很難在未來禁止自動(dòng)駕駛汽車。在理想情況下,它們的反應(yīng)和決策能力確實(shí)是無可挑剔的:它們能夠根據(jù)預(yù)設(shè)的程序決定,到底是選擇挽救追皮球的孩子,還是騎自行車的人。

那么應(yīng)由誰來制定機(jī)器人的道德規(guī)則?又該如何制定這種道德規(guī)則?要回答這些問題并不容易,但是不可避而不談。如一些研究者證明的那樣,在邏輯學(xué)家看來,有些道德問題的邏輯過于復(fù)雜甚至是不可判定的。

現(xiàn)在的機(jī)器人沒有被預(yù)裝阿西莫夫定律的另一個(gè)原因是:我們制造某些機(jī)器人的目的就是為了殺戮。這已經(jīng)變成了一個(gè)嚴(yán)重的問題,值得我們思考和討論。

人類制造用來殺戮同類的機(jī)器人已經(jīng)有數(shù)十年的時(shí)間,而且只要“機(jī)器人”“自主性”和“殺戮”這個(gè)三個(gè)特性一同出現(xiàn),情況就變得十分棘手。拿地雷舉例,我們可以說它具有自主性,因?yàn)楫?dāng)它“覺察”到四周出現(xiàn)物體時(shí)會(huì)“決定”爆炸,而這個(gè)決定并不需要人類的許可。美國在許多戰(zhàn)場上使用的無人機(jī)其實(shí)是遠(yuǎn)程遙控的,通常情況下,它們?cè)谕斗盼淦髑皶?huì)等待操作員給出明確的指令。不過在執(zhí)行對(duì)地打擊任務(wù)時(shí),它們同樣造成了不小的傷害,奪取了許多無辜者的生命。一些無人機(jī)可以在自動(dòng)模式下工作,自行決定是否開火,并不需要人類的干涉。

在聯(lián)合國于2013年發(fā)表的一份報(bào)告中,南非比勒陀利亞大學(xué)的法學(xué)教授克里斯托弗·海因斯認(rèn)為,自主殺人機(jī)器人已經(jīng)在一些國家的軍方實(shí)驗(yàn)室誕生了,并且磨刀霍霍準(zhǔn)備開始行動(dòng)。毫無疑問,人類能夠創(chuàng)造并利用具有部分智力的自主軍事武器,把它們派遣到地面戰(zhàn)場上或空中去搜索敵人。無須人類許可,它們就能自己辨認(rèn)并消滅目標(biāo)。就算我們假定在戰(zhàn)斗決策中有人類存在,如果不對(duì)這些機(jī)器人自主性的深層概念進(jìn)行調(diào)整的話,它們?nèi)钥梢云查_人類獨(dú)自執(zhí)行任務(wù)。

■我們要往何處去?

現(xiàn)在,我們需要回答的問題可歸結(jié)為:我們是否真的希望在這條路上走下去?是否應(yīng)該限制或者禁止使用自主殺人機(jī)器人?

在為這些武器系統(tǒng)辯護(hù)的論據(jù)中,有兩條關(guān)鍵的理由。首先,現(xiàn)在采取任何措施都已太遲,這些系統(tǒng)已經(jīng)存在。其次,這些機(jī)器人終有一日會(huì)變得更為精準(zhǔn),它們會(huì)更加尊重平民和交戰(zhàn)規(guī)則。總而言之,這些武器能夠讓戰(zhàn)爭和沖突變得更為“干凈”。

第一條論據(jù)可以被輕松反駁。人類已經(jīng)制造出了核武器、化學(xué)武器以及細(xì)菌武器,但這不能阻止各國簽訂國際條約來管理和禁止這些武器。這些協(xié)議的簽訂有效限制了上述武器的使用。因此,各國政府可以協(xié)商一致,停止自主殺人機(jī)器人的研發(fā)。現(xiàn)在這個(gè)問題已被搬上了國際法庭進(jìn)行討論。

第二條論據(jù)——?dú)⑷藱C(jī)器人可使戰(zhàn)爭變得更加“干凈”是無效的。實(shí)際上,這條論據(jù)等同于將“只攻擊敵人”“不要攻擊平民”等道德準(zhǔn)則強(qiáng)加給殺人機(jī)器人。然而,我們連怎樣將阿西莫夫的機(jī)器人定律寫入系統(tǒng)代碼都做不到,這些道德準(zhǔn)則更是無從談起。

或許,當(dāng)我們研發(fā)出具備更加先進(jìn)分析能力的機(jī)器人時(shí),再重新考慮這個(gè)問題也不遲。但就目前而言,我們無法編寫出類似于阿西莫夫機(jī)器人定律的道德規(guī)范。機(jī)器人需要有精確移動(dòng)的能力,能夠向人類或非人類目標(biāo)快速而準(zhǔn)確地開火,但它們不能決定是否開火,以及對(duì)誰投放致命的火力。

一封發(fā)表在2015年7月的公開信得到了2萬人左右的簽名,簽名者是人工智能領(lǐng)域的專家以及其他對(duì)此話題頗為關(guān)切的人,其中包括著名物理學(xué)家斯蒂芬·霍金以及蘋果公司聯(lián)合創(chuàng)始人史蒂夫·沃茲尼亞克。這封公開信要求停止研發(fā)具有殺人能力的自主系統(tǒng),并表示這些系統(tǒng)可以被恐怖分子當(dāng)作武器。

自主殺人機(jī)器人的問題比其他類型的武器(如核武器)更嚴(yán)重,因?yàn)樽灾鳉⑷藱C(jī)器人的技術(shù)研發(fā)比較分散。機(jī)器人是由眾多程序和相對(duì)容易獲取的硬件制造而成的。但是,其軟件易于復(fù)制和傳播,這與核武器完全不同。機(jī)器人技術(shù)領(lǐng)域的任何進(jìn)步都有可能被最邪惡的恐怖分子盜取。

■機(jī)器人的反叛

那么,如何避免程序漏洞,使得殺人機(jī)器人不會(huì)攻擊人類?或許一行不巧被刪掉的代碼就能產(chǎn)生這樣的漏洞,我們是否可以把機(jī)器人的這種行徑視為反叛?這個(gè)問題和人類的追責(zé)機(jī)制類似。即使殺了人,精神病患者是不用負(fù)刑事責(zé)任的。因此,需要定義什么叫“機(jī)器人發(fā)瘋”。最為可能的情況是,機(jī)器人出現(xiàn)了軟件故障。機(jī)器人反叛的真正問題首先在于如何定義反叛,而想要給出這項(xiàng)定義卻困難重重。如何區(qū)分愚蠢的故障和有意為之的反叛呢?

美國康涅狄格大學(xué)著名機(jī)器人倫理問題專家蘇珊·安德森提出,機(jī)器人造反實(shí)際上可能是正當(dāng)?shù)摹T谒磥恚赖聦W(xué)巨匠伊曼努爾·康德就曾間接地討論過智能機(jī)器人的問題。她重新審視了阿西莫夫的機(jī)器人定律:如果“機(jī)器人”有能力理解并實(shí)踐機(jī)器人定律,那么我們是否有權(quán)將這些定律強(qiáng)加于它們,并要求它們成為人類的奴隸呢?

蘇珊·安德森指出,按照康德的觀點(diǎn),人類欠動(dòng)物一份尊重,因?yàn)橹挥形覀冏鹬厮鼈儯鼈儾艜?huì)尊重我們。她認(rèn)為依據(jù)同樣的道理,如果康德也曾思考過機(jī)器人的問題,他可能會(huì)支持這樣一種觀念:如果有一天能夠理解機(jī)器人定律的機(jī)器人真的出現(xiàn)了,那么我們應(yīng)當(dāng)尊重它們,向它們強(qiáng)加機(jī)器人定律也就無從談起了。

科幻作品以輕松愉快的方式處理了這些與現(xiàn)實(shí)相距甚遠(yuǎn)的問題,科學(xué)和哲學(xué)又迫使我們重新思考。我們亟須對(duì)目前已經(jīng)出現(xiàn)的機(jī)器人進(jìn)行公正的評(píng)估并采取相應(yīng)的手段。這些復(fù)雜的評(píng)估任務(wù)包含了許多難解的倫理和哲學(xué)謎題,而其中一些迫切需要答案。哲學(xué)家、倫理學(xué)家、軍方人士和軟件工程師應(yīng)當(dāng)展開討論并達(dá)成一致的意見。

(作者為法國里爾第一大學(xué)計(jì)算機(jī)基礎(chǔ)科學(xué)學(xué)院教授,本文由《環(huán)球科學(xué)》雜志社供稿)